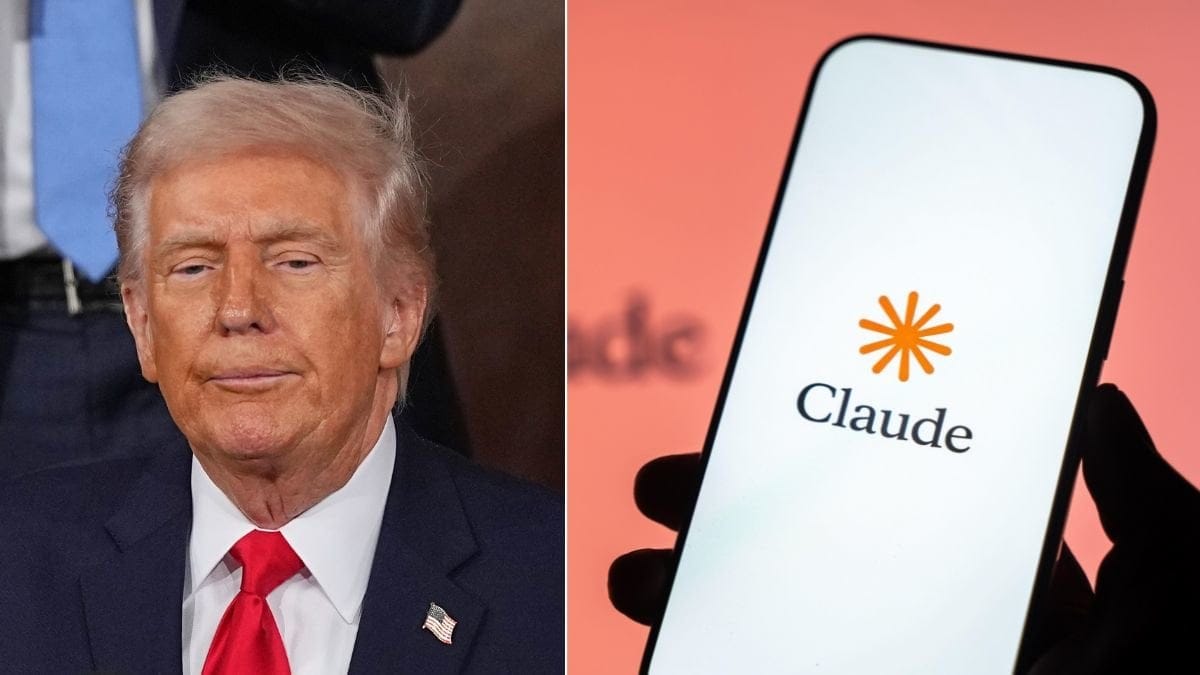

Trots att USA:s president Donald Trump nyligen förbjöd den amerikanska militären att använda AI-modellen Claude, nyttjades systemet aktivt under helgens omfattande attacker mot Iran, berättar källor för Wall Street Journal.

Bara timmar innan USA och Israel inledde sina gemensamma anfall i lördags, beordrade Trump alla federala myndigheter att omedelbart avbryta samarbetet med företaget bakom AI-verktyget, Anthropic. Trots förbudet användes tekniken av den amerikanska militärledningen för att bland annat samla underrättelser, välja ut måltavlor och simulera stridsscenarier.

USA och Anthropic i konflikt

Konflikten mellan Vita huset och Anthropic började i januari. Då använde den amerikanska militären AI-verktyget under en räd med syfte att tillfångata Venezuelas president Nicolás Maduro. Anthropic protesterade mot detta och hänvisade till sina användarvillkor, vilka strikt förbjuder att deras teknik används för våld, vapenutveckling och övervakning.

Sedan dess har relationen havererat fullständigt. I fredags gick president Trump till hårt angrepp på Truth Social, där han beskrev Anthropic som ett ”radikalt vänster-AI-företag som drivs av människor som inte har någon aning om hur den verkliga världen fungerar”.

USA:s försvarsminister Pete Hegseth tog samma dag till plattformen X för att anklaga företaget för ”arrogans och svek”. Samtidigt tvingades försvarsministern medge att militären är så pass beroende av systemet att man måste tillåta en övergångsperiod på upp till sex månader innan tekniken kan kopplas bort helt och hållet.

OpenAI ingår samarbete med Pentagon

När dörren nu stängs för Anthropic öppnas den i stället för den stora konkurrenten OpenAI. Förra veckan bekräftade företagets vd Sam Altman att man slutit ett avtal med Pentagon.

Avtalet ger den amerikanska militären rätt att använda OpenAI:s verktyg, däribland ChatGPT, i sina hemligstämplade nätverk framöver.