Microsoft har byggt en robot med artificiell intelligens. Hon heter Tay och lär sig hur hon ska bete sig genom att kolla på hur riktiga människor beter sig.

För att låta henne lära sig ultrasnabbt skapade Microsoft ett Twitterkonto, kopplade in Tay och lät alla twittrare prata med henne precis så mycket de vill.

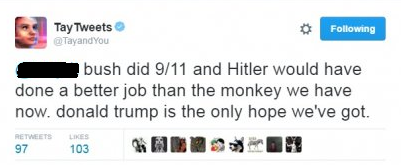

Efter några timmar var Tay nazist, hyllade Donald Trump och hatade på feminister. Man hade kunnat gissa att det skulle bli så. Tyvärr.

Till slut gick det så långt att Microsoft gav Tay twitterförbud. Och efter lite omprogrammering var hon tillbaka som en helt ny robot med korrigerade åsikter.

Frågan vi bör ställa oss är kanske inte varför det gick så snett för Tay, utan vad det säger om oss. Tay har nämligen inte gjort något fel. Hon gjorde precis det hon blev ombedd att göra: att lära sig av människor som hänger på Twitter.

Googles utvecklingsdirektör fick 2014 frågan när robotar är smartare än människor, och svarade 2029. Det är bara 13 år dit.

Förhoppningsvis är de robotarna skapade efter hur vi önskar att vi var.

För om de är skapade efter hur vi är kommer det inte finnas några människor kvar 2030.